全面解析Lamini:企業級AI訓練模型平台的先鋒

在AI革命浪潮下,更多企業希望低門檻搭建客製化大語言模型(LLM)。Lamini,正是在這一趨勢下脫穎而出的企業級平台,提供從AI訓練模型、模型調優到推理服務的一站式解決方案。本文將以新聞報導的風格,為廣大企業與開發者深入解析Lamini的核心價值、技術亮點與應用潛力。

全面解析Lamini:企業級AI訓練模型平台的先鋒在AI革命浪潮下,更多企業希望低門檻搭建客製化大語言模型(LLM)。 Lamini,正是在這一趨勢下脫穎而出的企業級平台,提供從AI訓練模型、模型調優到推理服務的一站式解決方案。本文將以新聞報導的風格,為廣大企業與開發者深入解析Lamini的核心價值、技術亮點與應用潛力。

(官方網址: https://lamini.ai/)

Lamini平台簡介Lamini是一家位於美國加州、於2022年成立的AI科技公司,其核心產品Lamini平台為企業提供開放LLM(大型語言模型)的訓練、優化和部署服務,強調「企業級AI訓練模型的極致簡化」。無論本地、私有雲或公有雲,Lamini都能相容部署,並全面支援NVIDIA與AMD GPU硬件,加速企業越級邁入AI新時代。 查看官網更多資訊Lamini的創始團隊具備強大的學術與產業背景-科學研究成果涵蓋LLM擴展定律、生產環境AI大規模迭代,以及亞馬遜、Google、OpenAI等業界標竿經驗。平檯面向所有具備AI需求的企業,不再限定機器學習博士或專職AI團隊,降低了產業進入障礙。

Lamini的主要功能Lamini以「低程式碼」、「高相容性」、「高可控性」為主要理念,致力於幫助企業靈活擁有自己的AI訓練模型,主要功能亮點如下:

(詳細開發文件與官方Demo,請訪問Lamini Docs)

1. 快速AI訓練模型定制

支援LoRA等微調技術,透過自有API和Python SDK,無需ML專家、僅幾行程式碼即可完成本地/雲端高品質微調。 配備RLHF(人類回饋強化學習)、Prompt Engineering等最佳化路徑,助力模型生成準確度大幅提升。

2. 數據產生與擴充

內建強大的生成器,可將小批量資料自動擴展為海量訓練集,支援實用場景如問答、摘要、結構化資訊生成。 資料驗證與自動清洗工具,大幅減輕企業資料前置處理壓力。

3. 高速推理與批量推理

極致高吞吐推理API,適合大規模文字、文件的後台批次推理與即時回應場景。 結構化JSON輸出,方便和企業系統做深度集成,大大降低應用出錯率。

4. 多環境靈活部署

跨本地(on-prem)、公有雲(如AWS、GCP)、私有雲和隔離網路(air gapped)靈活部署。 支援GPU叢集自動編排,輕鬆應付百萬級並發訓練與推理請求。

5. 資料與安全合規

企業級資料隔離與安全,確保自有資料絕不外洩,為合規性強需求客戶提供強力基礎。 管理工具可自訂日誌、權限、呼叫頻次及模型版本回溯。

主要功能速覽表

| 功能類別 | 說明 | 技術特色 |

|---|---|---|

| 模型訓練與最佳化 | LLM客製化與個人資料微調 | 支援LoRA、RLHF等 |

| 數據生成與擴充 | 小樣本產生大數據 | Prompt工程/自動清洗 |

| 推理與集成 | 快速API批量推理+結構化輸出 | 高吞吐量/JSON結果 |

| 部署與相容 | 本機、雲端、GPU自動擴展 | 支援NVIDIA、AMD/多雲環境 |

| 安全與管理 | 權限全控、資料隔離、稽核溯源 | 企業級加密/合規性支持 |

詳細API和業務場景範例可進一步查閱Lamini官方文檔。

Lamini的價格& 方案Lamini面向不同類型企業,隨選提供靈活的價格與服務方案。其主要定價模式總結如下:

| 方案類型 | 主要對象 | 獲得的服務 | 價格 |

|---|---|---|---|

| 免費套餐 | 開發者/小規模實驗 | 200次推理/月+有限調優嘗試 | $0 |

| 企業套餐 | 中大型團隊/企業 | 無限推理/調優/私有模型權重下載/專家支持 | 客製化(需聯絡銷售) |

免費註冊即送$20試用推理積分,適合初學者體驗企業版不限模型類型與容量,可完全定制吞吐量與時延需求,還能直接下載微調後模型權重支持信用卡支付及企業賬期,詳細結算方式與定價以官網最新公告為準

特別說明:針對高頻批量AI訓練模型與大規模推理客戶,Lamini可提供GPU預留、專屬頻寬、自訂安全加固等深度企業級合作選項。 點擊聯絡Lamini團隊取得客製報價

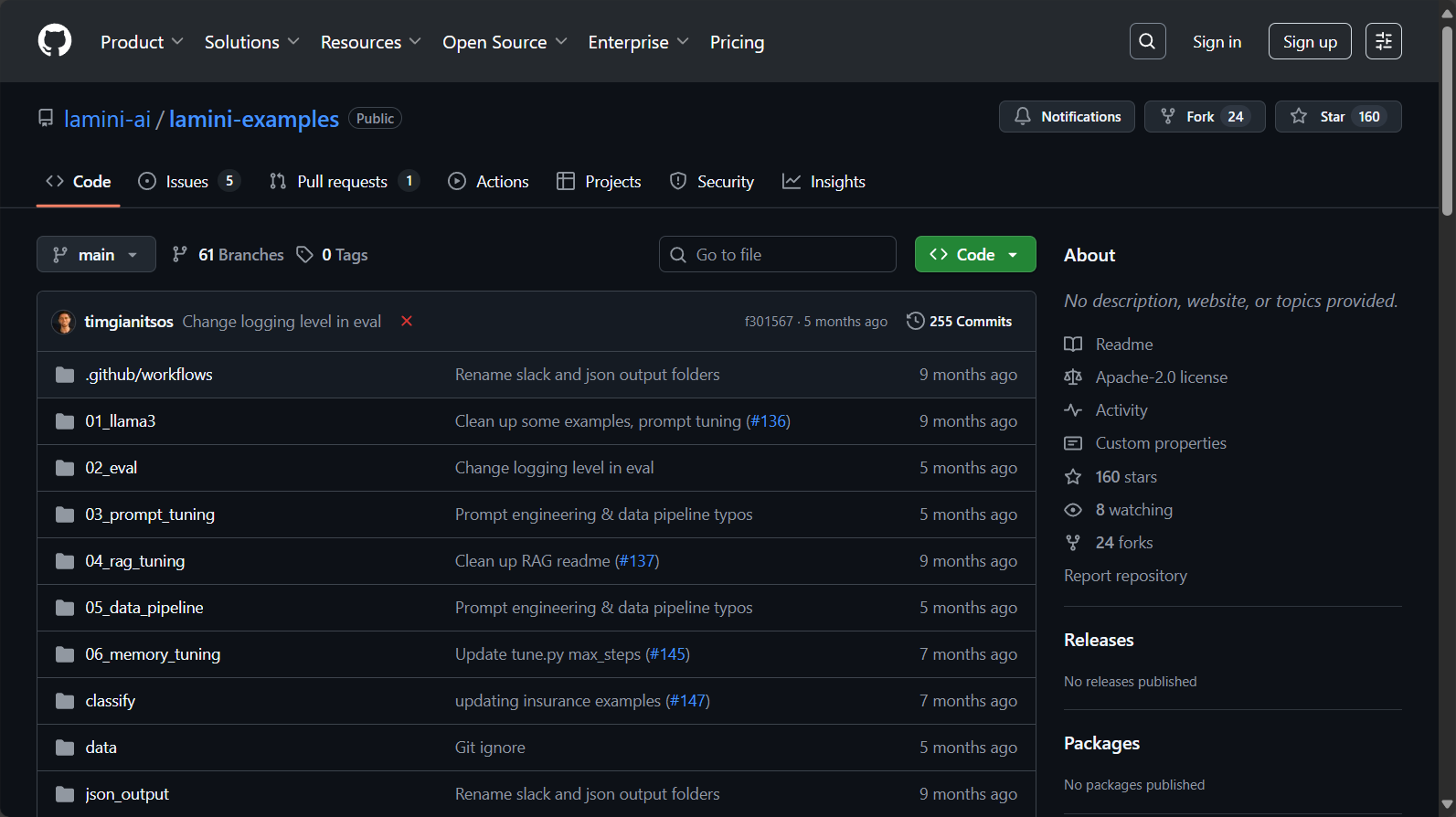

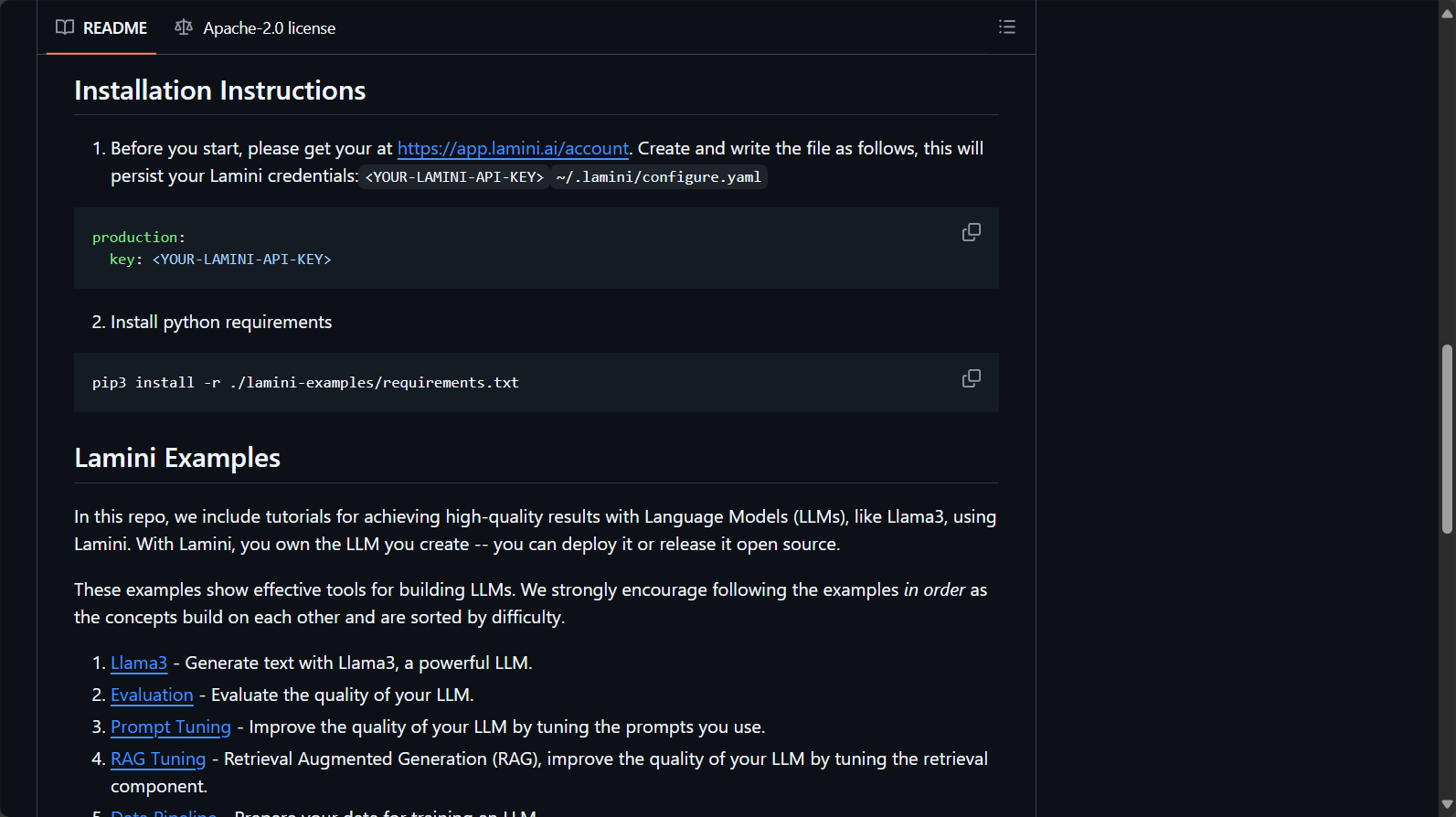

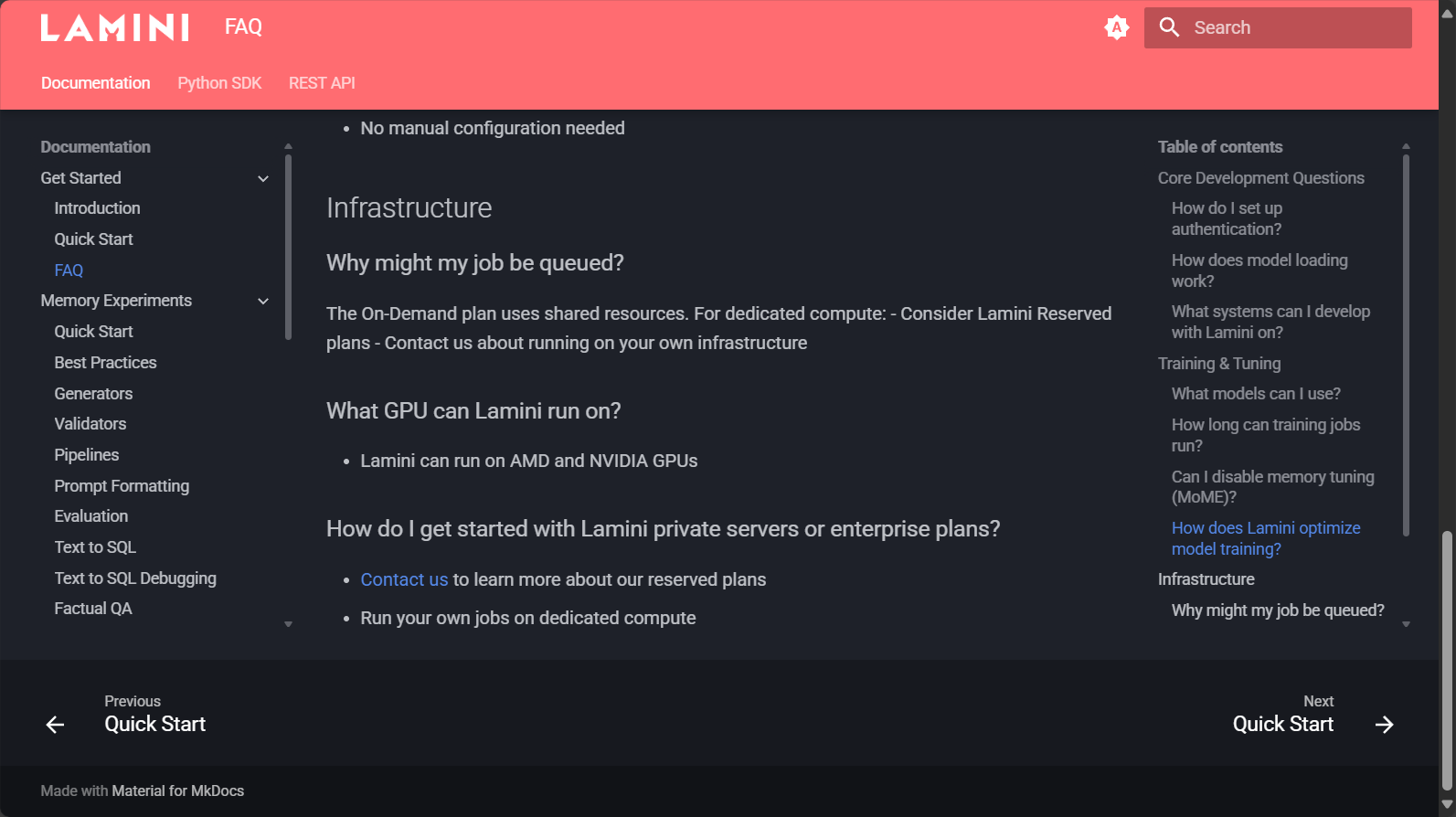

如何使用Lamini 1. 帳戶註冊與API申請前往hugging faceLamini線上體驗。 支援Python SDK、RESTful API對接,無論是小工具工程師或企業IT都可快速整合。

2. 基礎模型客製化流程

上傳/配置企業私有資料(如知識庫、合約、FAQ等)。 透過平台自動資料產生器擴展訓練樣本。 選擇/上傳基礎LLM(平台可相容於多種主流開源/自研模型)。 呼叫API或用Python SDK

from lamini import train_llm model = train_llm(task='qa', data=your_data, …)

微調完成後,模型可立即上線推理,或匯出權重本地部署。

3. 整合與二次開發

Lamini可作為內部AI中台,結合內業務數據,低程式碼擴充知識問答、文件產生、智慧客服等場景。 支援高並發非同步批量請求,有詳細團隊協作與版本管理機制。 使用過程中如遇問題,可透過開發文件社群提問、或聯絡官方技術支援。

Lamini的適用人群主要適用對象

| 適用人群 | 理由與應用場景 |

|---|---|

| 企業/大中型機構 | 需處理大量專有文件、資料安全性高等客製化AI需求 |

| AI新創公司 | 需快速搭建PB級模型、敏捷上線新功能 |

| IT/數位化團隊 | 用於內部知識庫對話助理、智慧維運、企業流程優化等 |

| AI教育科學研究機構 | 驗證新模型理論、生成教學或科學研究範例 |

| AI外包服務商 | 實現多用戶、多業務場景下的LLM快速交付 |

典型產業案例

金融:自動生成報告、反詐欺風控文字分析、智能投顧醫療:病例解讀、文件摘要、科普內容自動生成零售/電商:商品文案生成、客服機器人、客戶輿情分析製造業:工藝文檔寫作、維護知識庫對話、合規材料歸集

Lamini為何成為領先AI訓練模式平台? 技術創新與產業應用的深度融合,是Lamini最大特色:

客製化高精度:Memory Tuning、LoRA調優+Experts in-the-Loop多維提升企業資料上的任務準確率推理資源極致利用:同等硬體下GPU利用率提升32倍,支援AMD GPU,打破NVIDIA一家獨大全景部署能力:可本地、斷網、混合雲靈活部署,資料始終可控,企業IT安全合規得以保障開發者友好:以開發者至上的API和簡單的SDK為根本,文檔完善,降低AI落地門檻

與常見開源自訓框架/雲端API一站式能力比較:

| 維度 | Lamini | Huggingface | OpenAI平台 | 微調難度 | 相容性 | 推理吞吐 | 企業專用性 | 數據全控性 |

|---|---|---|---|---|---|---|---|---|

| ☆☆☆☆☆ | 輕鬆 | 較高 | 僅限API | 低 | 高 | 極高 | 極強 | 極佳 |

深入了解Lamini技術文檔

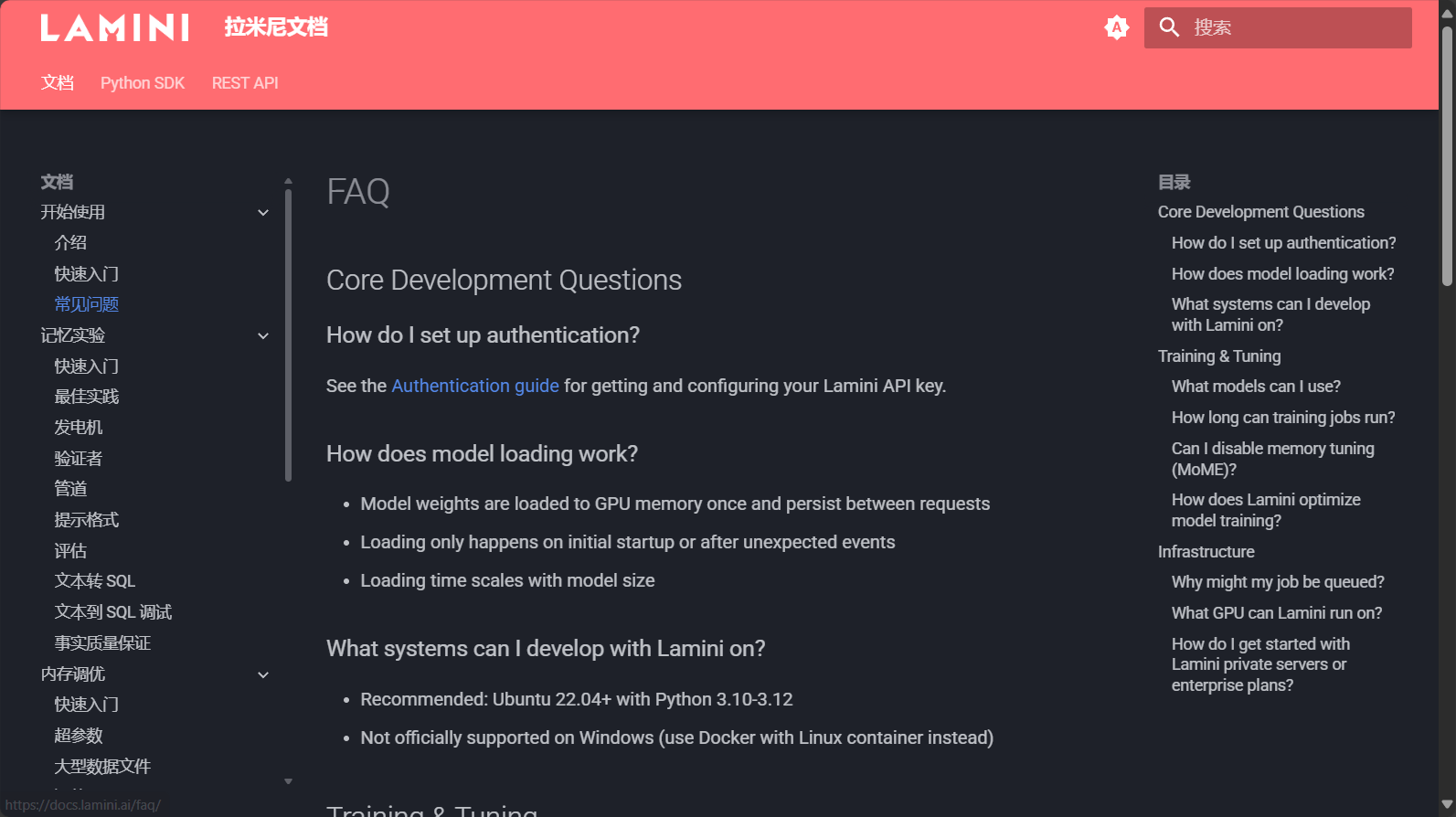

常見問題1. Lamini支持哪些AI模型的訓練與微調? Lamini完全模型無關(model-agnostic),支援主流開源LLM(如Llama、GPT-3/4家族、Mistral等)及企業自研基礎模型的自助訓練、調優與推理,相容無縫切換,無需擔心「只支援平台自研模型」限制。 更多詳情請見官網支援模型列表

2. Lamini部署與資料安全如何保證? 平台原生支援本地私有部署及隔離網路環境,所有企業資料、模型參數可100%留在自有基礎設施。本平台也具備詳細資料加密、存取權控制與安全稽核機制,適用於對資料隱私與合規性極度敏感的金融、醫療等產業。 造訪「Self-Hosted」部署指南

3. Lamini與開源自訓or 純API雲模型有何核心差異?

Lamini倡導“低門檻專屬模型”,讓非AI專業團隊快速擁有自己的AI訓練模型,並能下載權重、自主管理與升級; 並非“即拋即用API”,更強調企業數位資產安全與AI可持續成長能力; 同時,Lamini整合了微調、資料生成、推理介面、權限管理、監控等全流程,完勝「光有訓練不易落地」的研究工具,也規避全部依賴第三方雲端AI的風險。

結語Lamini正在驅動AI訓練模型技術大步走向企業級自主時代。它不僅為大企業解決了資料安全、效能與快速落地的痛點,也大大壓縮了新銳團隊與AI巨頭的技術鴻溝。對於未來中國企業想佔據AI智能業務的高地-擁抱Lamini這樣可掌控、自成長的AI訓練模型平台,無疑是最具前瞻性的策略選擇之一。

想要體驗Lamini的智慧力量?現在就訪問其官方網站,開啟客製化企業AI模型的新紀元!

數據統計

數據評估

本站AI 喵導航提供的Lamini都來自網絡,不保證外部連結的準確性和完整性,同時,對於該外部連結的指向,不由AI 喵導航實際控制,在2025年7月26日下午12:02收錄時,該網頁上的內容,都屬於合規合法,後期網頁的內容如出現違規,可以直接聯繫網站管理員進行刪除,AI 喵導航不承擔任何責任。

相關導航

SEO Vendor

Resume Worded

PFP.AI

AI Short

Cutout.Pro Retouch

沉浸式翻譯

鮮藝AI摳圖