LLaMA是Meta研發的新一代開源大型語言模式平台,以高效能、多語言支援、開源靈活性和強大生態體系受到開發者與企業的廣泛關注。 LLaMA不僅提供多種模型規格(從本地輕量到超大規模),還相容於主流AI推理框架,適合學術研究、企業應用和個人開發多樣需求。目前LLaMA免費開放權重下載,但商用需合規,已成為推動AI創新的重要平台之一。

作為全球AI領域的創新佼佼者,Meta(原Facebook)於2023年首次對外發布了自研的大型語言模型(Large Language Model, 簡稱LLaMA)。近年來,LLaMA已迅速成為AI社群的焦點,無論是前沿的AI研究或企業級場景應用,這項工具都顯示出極大的潛力。本文將以新聞深度報告形式,帶您全面了解LLaMA的最新發展、功能、定價、使用方式及適用人群等關鍵資訊。

LLaMA工具簡介

LLaMA(Large Language Model Meta AI)是Meta推出的開源大型預訓練語言模型集合。自2023年首次登場後,LLaMA憑藉著優秀的性能、開源精神與強大社區生態,快速累積了廣泛用戶基礎。其最新版本(LLaMA 3.1)以更強泛化能力和多語言、多任務適應力成為目前最有影響力的開源AI訓練模型之一。

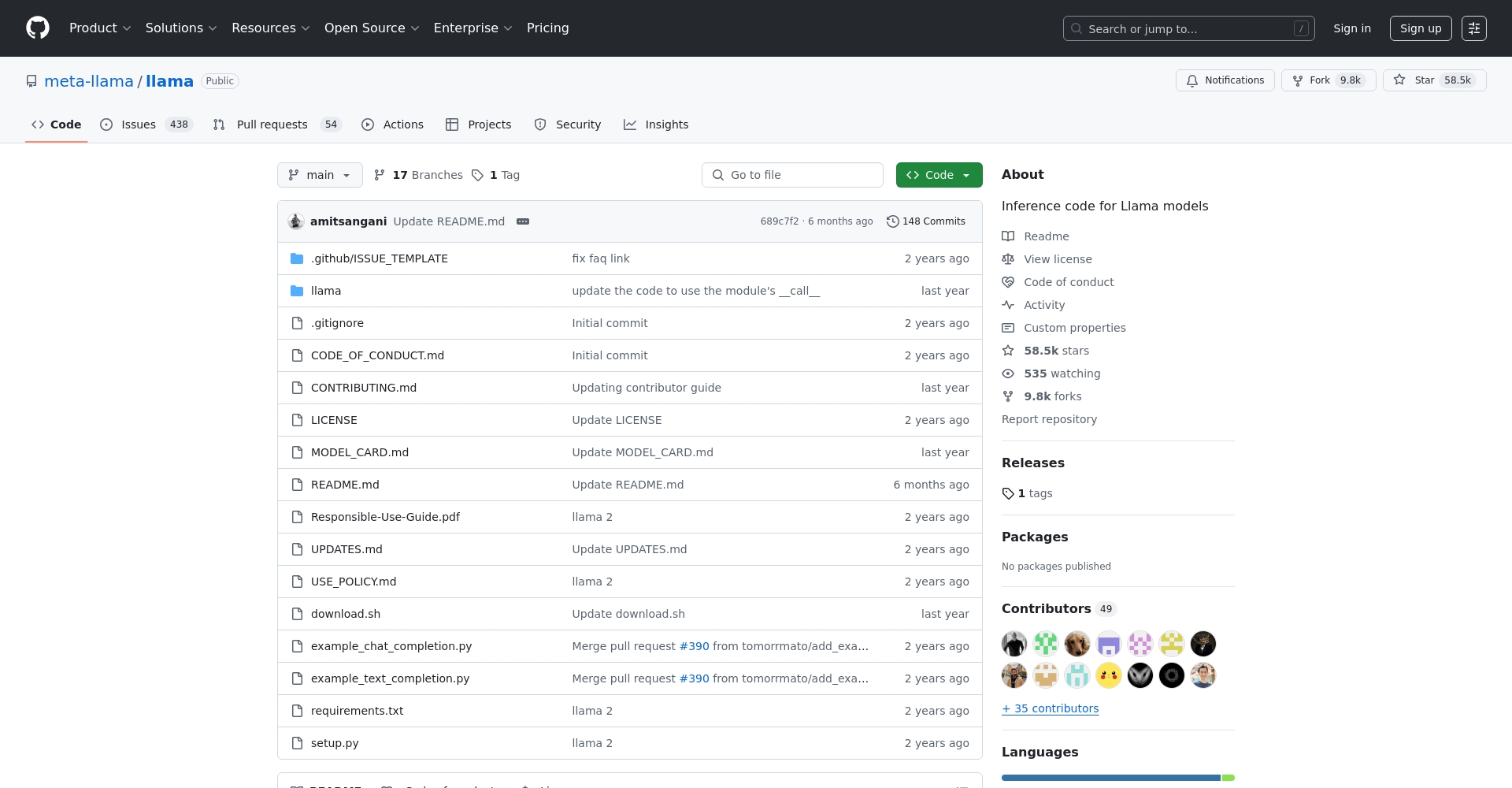

- LLaMA專案地址:https://github.com/facebookresearch/llama

- LLaMA官方網站:https://www.llama.com/

延伸閱讀:想要了解LLaMA的背景與發展沿革,可以點選Meta官方博客取得詳細解析。

LLaMA的主要功能

作為一款新一代AI訓練模型平台,LLaMA提供了以下主要功能:

1. 多語言強大理解與生成

LLaMA系列模型在預訓練階段引入了大量多語種數據,能夠處理英語、中文等30多種主要語言,為國際化場景帶來更多可能。

2. 多尺寸模型選擇,靈活適用不同算力需求

LLaMA從7B(70億參數)到405B(4,050億參數)的多種模型規格,涵蓋輕量本地部署與雲端大規模應用。核心參數如下表:

| 版本 | 參數規模 | 主要用途 | 最大上下文長度 |

|---|---|---|---|

| LLaMA 2 | 7B/13B/70B | 基礎NLP任務、本地推理 | 4K |

| LLaMA 3 | 8B/70B | 高階理解、對話生成 | 8K以上 |

| LLaMA 3.1 | 8B/70B/405B | 超大規模知識推理、多語言場景 | 128K |

查看模型詳情與下載,請訪問LLaMA模型庫。

3. 支援針對垂直需求微調與客製化

LLaMA具備全面支援指令微調、持續預訓練、函數呼叫、RAG(檢索增強生成)、合成資料產生等AI應用關鍵工作流程,開發者可靈活自訂屬於自己的AI訓練模型。

4. 安全合規與開源生態

- 提供Llama Guard、Prompt Guard等安全元件,協助企業使用者規避模型在實際應用上的合規風險。

- 完善的API介面、豐富的社群工具(如Llama.cpp、LlamaIndex),確保快速整合與二次開發能力。

補充閱讀:查看LLaMA生態案例與社區應用,請點這裡 LLaMA社區故事。

LLaMA的價格& 方案

LLaMA模型本身對研究和開發使用免費開放,但實際落地過程涉及不同的服務方案,主要有以下幾類:

| 方案類型 | 計費模式 | 適用對象 | 參考連結 |

|---|---|---|---|

| 開源模型權重下載 | 免費 | 開發者、研究者 | GitHub下載頁 |

| 雲端API呼叫 | 合作平台按API計價 | 企業、開發商 | AWS LLaMA服務 |

| 客製化支援服務 | 商業談判或進階會員制 | 大型企業、策略夥伴 | LLaMA官網 |

| 本地部署與商用 | 遵循Meta社群授權協議 | 自主整合項目 | License細則 |

特別注意:LLaMA模型雖然開放下載和研究,但對於生產商用、軍事等敏感領域有嚴格限制,請在閱讀官方授權協議後合規使用。

如何使用LLaMA

LLaMA支援多種主流開發框架與部署流程,無論你是深度AI工程師還是一般應用開發者,都能快速上手:

基礎使用流程(以本地部署為例)

- 取得模型權重 透過GitHub LLaMA倉庫或HuggingFace下載所需模型權重。

- 準備運作環境 支援主流作業系統,配合PyTorch、Llama.cpp等多種推理框架。

- 載入模型並推理 官方提供多種範例程式碼和推理腳本,開發者可按需自訂輸入輸出格式。

- 任務微調/持續預訓練 根據業務需求可以進行SFT(監督微調)、DPO(直接偏好優化)、RAG、LLM Agent開發等高階任務。

- 整合第三方應用 如透過LlamaIndex、LlamaHub等生態工具連接企業知識庫,快速實現RAG應用。

範例程式碼片段

from transformers import LlamaTokenizer, LlamaForCausalLM tokenizer = LlamaTokenizer.from_pretrained("facebook/llama-2-7b-hf") model = LlamaForCausalLM.from_pretrained("facebook/llama-2-7b-hf") input_ids = tokenizer("你好,LLaMA!", return_tensors="pt").input_ids outputsrate model.gene

開發詳解:LLaMA模型開發文檔

LLaMA的適用人群

LLaMA面向如下人群提供了靈活能力與工具支持:

| 適用人群 | 應用場景 | 建議版本 |

|---|---|---|

| AI開發者 | AI訓練模型研發、NLP學術研究 | LLaMA 2/3.1基礎版 |

| 企業研發團隊 | 知識管理、企業RAG、自動化辦公室助理等 | LLaMA 3.1 70B/405B |

| 創業團隊 | 客製化AI助理、業界專用AI應用 | LLaMA 3.1 8B |

| 教育醫療等行業 | 教學輔助、醫學問診、文件理解 | LLaMA 2/3(指導微調版) |

| 個人開發者 | 本地AI實驗、AI學習社群分享 | LLaMA 2 7B |

此外,大量開源專案(如Alpaca、MedLM等)基於LLaMA進行二次開發,形成垂直產業應用閉環。

拓展閱讀:LLaMA社區貢獻案例

LLaMA的技術架構與生態系統

模型架構進化

LLaMA堅持標準的解碼器Transformer架構,在原始結構基礎上做了以下優化:

- 使用SwiGLU激活函數優化效能;

- 引入RoPE位置編碼,提升長文本處理能力(上下文視窗最高128K);

- 支援8-bit量化,便於高效推理和落地部署;

- 多版本模型互補適配,橫跨文字產生、程式碼產生、多模態(vision-text)等。

主要生態工具

| 生態工具 | 主要功能 | 適用類型 | 入口連結 |

|---|---|---|---|

| Llama.cpp | C++重寫,支援本地CPU/GPU運行 | 輕量本地推理 | 專案首頁 |

| LlamaIndex | 企業級文件檢索與RAG開發 | 知識管理/企業搜尋 | LlamaIndex官網 |

| LlamaHub | 豐富的資料載入、Agent工具集 | RAG開發 | LlamaHub |

更多詳細生態介紹請見官方資源頁。

LLaMA的優勢與局限

優勢:

- 高可擴展性,高度開放,可下載權重自由客製化;

- 強大的社區生態體系,即插即用多樣化工具;

- 跨語種、跨任務能力突出,適合全球開發者與企業。

局限:

- 商業用途有限制,需遵循Meta官方許可;

- 超大參數模型對算力有較高要求,適合中大型企業或平台整合;

- 部分最新功能(如多模態處理、極大情境支援)需等待後續版本逐步開放。

常見問題

1. LLaMA開源後可以商用嗎?

答:LLaMA權重可免費取得用於研究、開發、非商業用途。商用需遵守官方授權協議,部分領域有限制(如軍事、政府關鍵基礎設施),建議詳細查閱授權協議。

2. LLaMA和GPT系列有什麼差別?

答:LLaMA和GPT均為基於Transformer結構的AI訓練模型。 LLaMA突出開源社群支援和輕量靈活性,適合自訂和自訂;部分版本(如LLaMA 2, 3, 3.1)效能已逼近、甚至超過部分同參數GPT模型。具體對比詳情可參考相關Benchmark表。

3. 如何在資源有限的本地環境部署LLaMA?

答:Llama.cpp等社群工具支援在低配設備如筆記本、樹莓派等進行輕量級推理。建議選擇7B~13B參數等級模型,搭配量化版本權重文件,確保推理速度與效果。詳細教學參考Llama.cpp工具說明。

在AI大模型風潮澎湃的2024年,LLaMA無疑成為新一代AI訓練模型平台的重要代表。它不僅以開源、強大、多語言和多模態的特性贏得開發者、企業和學術界的高度關注,也透過活躍的社群生態不斷推動人工智慧走向更多樣化的應用場景。無論你是AI從業者、開發者或科技愛好者,LLaMA都為你的AI創新之路提供了堅實的基石與廣闊的舞台。

想要馬上體驗、下載或加入LLaMA的生態?歡迎參觀LLaMA專案主頁或LLaMA官方網站。推動AI創新,讓AI為更多人所用,LLaMA正在路上。

數據統計

數據評估

本站AI 喵導航提供的LLaMA都來自網絡,不保證外部鏈接的準確性和完整性,同時,對於該外部鏈接的指向,不由AI 喵導航實際控制,在2025年7月15日下午5:21收錄時,該網頁上的內容,都屬於合規合法,後期網頁的內容如出現,可以直接聯繫網站管理員進行刪除,AI 導航喵不承擔任何責任。

相關導航

法智

Fireflies.ai

美圖AI文生圖

PFP.AI

Supertranslate

Zams

Upscalepics