2048核人工智慧伺服器以超强算力、灵活配置,成为2024年人工智能基础设施核心选择。本文围绕性能、主流硬件规格、应用场景与采购选型要点,梳理并对比各品牌旗舰型号,同时推荐高效AI工具及管理平台,助您精准选型、科学部署与高效运维2048核AI服务器。

2048核AI服务器市场现状与主流规格

市场背景:AI训练与推理加速需求引爆

2048核AI服务器成为AI基础设施升级的明星产品,广泛适配AIGC、大型语言模型、自动驾驶、视频分析、智慧医疗等高性能计算场景。依托主流x86(AMD/Intel)、ARM多路CPU+多线程+异构加速架构,实现超大规模并行任务处理。

主流规格总览

| 品牌/型号 | 架構 | 实体CPU数 | 单CPU核数 | 超线程 | GPU加速卡(选配) | 最大内存 | 网络带宽 | 典型應用 |

|---|---|---|---|---|---|---|---|---|

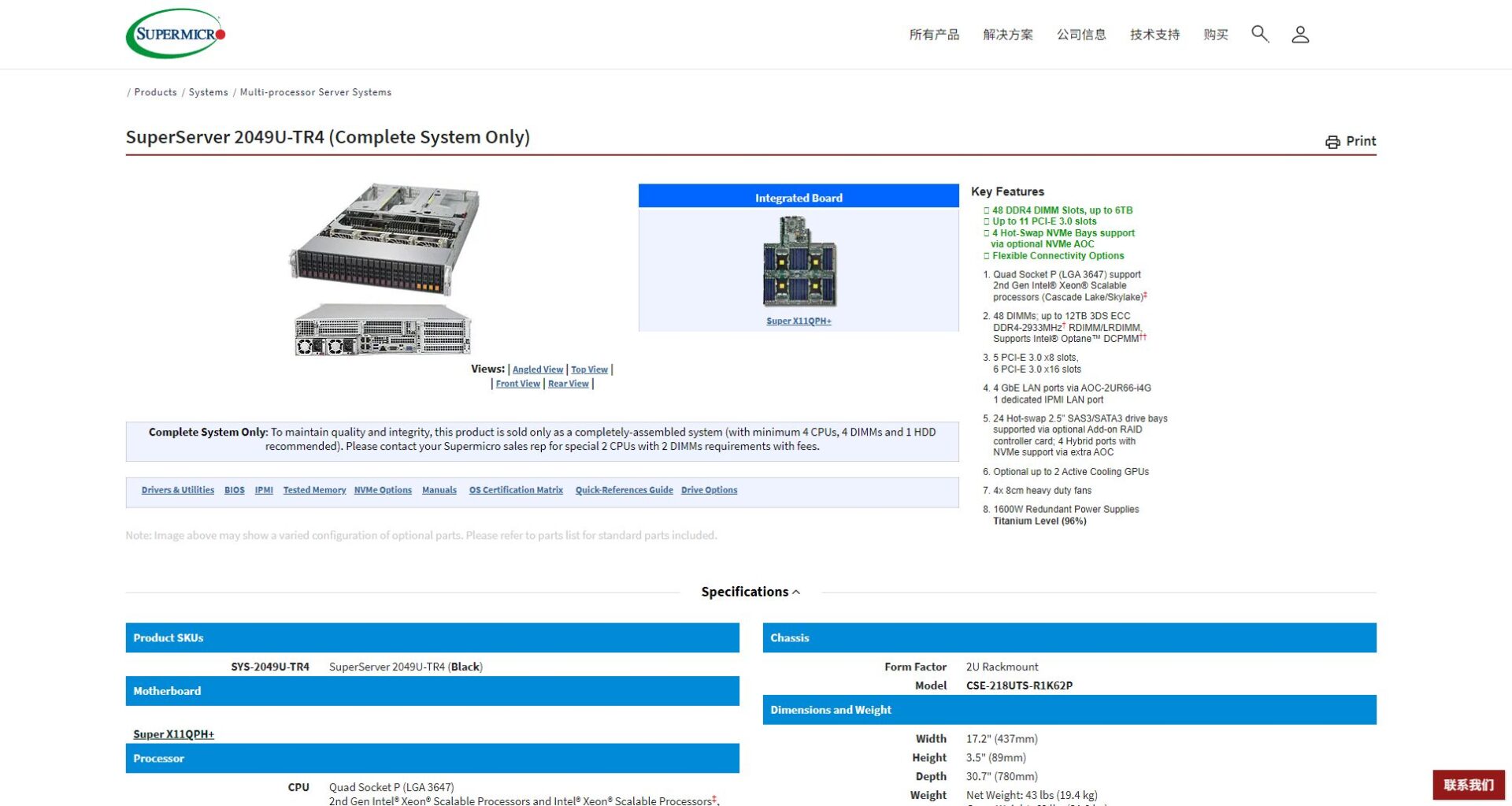

| 超微Supermicro 2049U-TR4 | x86/AMD | 8 | 128 | 支援 | NVIDIA H100(8/16) | 12TB | 200GbE | LLM训练/推理 |

| 戴尔PowerEdge XE9680 | x86/Intel | 8 | 112 | 支援 | NVIDIA A100(8) | 8TB | 400GbE | 視覺分析 |

| Inspur NF8480M6 | x86/Intel | 8 | 112 | 支援 | NVIDIA H100(8) | 8TB | 200GbE | 数据挖掘 |

| HPE Apollo 6500 Gen10 Plus | x86/AMD | 8 | 96-128 | 支援 | NVIDIA H100(8/16) | 12TB | 400GbE | 智慧醫療 |

| 华为Atlas 900 AI集群 | ARM/鲲鹏 | 算力池 | 自訂 | 支援 | Ascend 910B(1024卡) | 32TB | 1600GbE | 超大规模AI |

注:2048核AI服务器一般通过多路(4路-8路)CPU堆叠、支持超线程,并搭配数十张AI加速卡实现系统级2048逻辑核心。

核心选购要素

CPU与总核心数选型

主流产品采用8颗服务器级高核数CPU(如AMD EPYC 9754/Intel Xeon 8490H等),单CPU支持128核/112核及超线程,保证堆叠可达2048逻辑核心。

同时,现代AI服务器需支持大带宽PCIe Gen5、CXL拓展,搭配NVIDIA H100、A100等顶级AI加速卡,并结合如UPI、Infinity Fabric等高效互连架构。

内存方面,64-128条DDR5内存通道、12TB甚至32TB扩展,高带宽、低延迟与ECC可靠性是关键。网络采用400GbE至1600GbE高速互联,NVMe存储支撑PB级吞吐,完善大模型海量数据流需求。

典型应用场景解析

1. 大规模深度学习模型训练

2048核AI服务器支持ChatGPT、Llama等数百亿参大模型的分布式训练,单机可承载百万样本的并行计算,助力大型企业和AI研究院突破AI算力瓶颈。

2. 高并发AI推理

自然语言处理、视觉识别、智慧医疗等高频AI推理场景,通过多核心异步调度机制,支持数万并发推理请求。

3. 科学计算与仿真

生物医药、大气模拟、材料工程等科学计算与标准HPC仿真,对超高并发行与带宽极度敏感,2048核AI服务器实现一机多用。

4. 数据挖掘与大数据分析

PB/EB级企业数据分析、训练、归档均能通过超高核心与高速I/O大幅缩短周期。

主流“2048核”服务器方案清单

高端旗舰方案精选

| 方案名稱 | 架構 | 主要配置 | AI加速卡 | 適用場景 | 特色 |

|---|---|---|---|---|---|

| 超微 SuperServer 2049U-TR4 | x86/AMD | 8×EPYC 9754(128C)+12TB RAM | 8×NVIDIA H100 | LLM全流程 | 全面高配,易扩展 |

| 戴尔 PowerEdge XE9680 | x86/Intel | 8×Xeon 8490H(112C)+8TB RAM | 8×NVIDIA A100 | 通用AI训练 | 行业通用方案 |

| HPE Apollo 6500 G10 Plus | x86/AMD | 8×EPYC 9654(96C)+12TB RAM | 16×NVIDIA H100 | 超大数据场景 | 密度最高,商用适配 |

| Inspur NF8480M6 | x86/Intel | 8×Xeon 8490H(112C)+8TB RAM | 8×NVIDIA H100 | 企业AI/HPC | 价格竞争力强 |

| 华为 Atlas 900 集群 | ARM/鲲鹏 | 多节点合成2048核+32TB集群 | 1024×910B | 超大型集群 | 模块化弹性扩容 |

推荐AI工具与系统平台

- NVIDIA NGC深度学习平台:官方高性能AI模型与计算镜像库。

- AMD ROCm平台:面向高核数x86及AMD GPU加速体系。

- 华为Mindspore:为昇腾卡量身定制原生AI训练平台。

- Inspur AIStation:支持超大规模AI集群资源调度与可视化管理。

采购注意事项与选型深度解读

采购前需重点关注的技术要点

- CPU/内存/带宽配比:核算实际应用负载,精准匹配硬件构建。

- 系统散热与机柜配套:强建议采购含液冷&高效空调的数据中心一体化解决方案,关注TDP(>5000W)产品。

- 分布式架构与扩展性:检验集群互联(如InfiniBand)与分布式AI训练框架兼容。

- 平台兼容与节能认证:聚焦官方AI认证整机方案,长期协同运维有保障。

- 预算与售后服务:重视服务周期、硬件更换响应与平台定制能力。

服务器选购常见Q&A

| 問題 | 答案简要 |

|---|---|

| “2048核”是否为物理核心? | 多为逻辑核心(包含超线程),物理最大常在1024-1536核。 |

| 支持哪些主流AI平台? | 主流支持NVIDIA NGC、AMD ROCm、TensorFlow、PyTorch等。 |

| 是否支持国产AI加速卡与平台? | Intel/AMD机型可兼容国产FPGA/AI卡,ARM方案下华为昇腾生态成熟。 |

| 管理/监控平台有哪些? | 支持BMC、IPMI、NVIDIA DCGM等多平台管理监控。 |

如何选型适合自己的2048核AI服务器?

1. 明确目标应用与负载类型

若侧重大型语言模型训练与推理,建议选超高核CPU+NVIDIA H100方案并提升内存与带宽配置;如聚焦科学计算,则优先考虑高主频多核CPU+分布式文件加速组合。

2. 结合预算选性价比最佳方案

除旗舰配置外,部分企业用户也可关注“4路CPU+8GPU”灵活组合,有效控制预算并满足计算需求。

3. 注重服务与扩展

推薦整体方案集成、AI平台预装与定制服务的品牌机型,并优选通过官方AI生态认证的售后渠道。

進入AI大模型时代,2048核AI服务器不仅是计算引擎,更是企业智能转型与科技创新的核心驱动力。科学选型、精准部署、前瞻扩展,助您在智能时代把握数字竞争先机!

© 版權聲明

文章版權歸作者所有,未經允許請勿轉載。

相關文章

暫無評論...