Controlnet是近年來AI畫圖領域風頭最勁的影像可控生成技術,大大擴展了使用者對畫面結構、風格的精準把控能力。它基於Stable Diffusion深度架構,透過邊緣、骨骼、分割、法線等多種“條件圖”,大幅提升AI出圖準確率與互動體驗。本文系統解析controlnet原理、主流模型、生態工具與實戰教程,助設計師、業餘創作者有效率掌控AI繪畫流程,打造更高品質和個人化作品。

controlnet 的基本原理與架構進階

什麼是controlnet? AI 繪圖控制的革命性方案

controlnet 是用於「可控影像生成」的AI模型,嵌入於Stable Diffusion體系,讓使用者憑直覺條件圖(如邊緣、骨架、分塊等)直接介入AI出圖結構與風格,極大增強AI畫圖的準確性與實用性。相較於傳統依賴文字prompt的AI繪畫,controlnet憑多通道輸入,實現了「照葫蘆畫瓢」乃至精細部位重新渲染。

controlnet 為什麼能改變AI 繪畫體驗?

- 可控性極強:手繪邊線、骨架、分割圖,精準掌握AI畫面構圖與動作。

- 全場景適配:線稿、OpenPose、語意分割、深度圖等多模態通用,跨媒體創作自如。

- AI編輯進化:實現局部修補、人物調整、換景植入、風格遷移,賦予AI手工級操作力。

controlnet 工作流程解構

| 步驟 | 說明 |

|---|---|

| 1. 預處理 | 自動產生「控制條件」如Canny邊緣或OpenPose姿態 |

| 2. 編碼 | controlnet將控制訊息編碼混入主模型 |

| 3. 去雜訊迭代 | 主模型與controlnet聯合優化,精準還原結構 |

| 4. 多種融合 | 可多通道組合,複雜塊體/風格/部位同步控制 |

| 5. 輸出 | 輸出結果自動符合條件圖結構與要求 |

controlnet 主要模型種類與生態

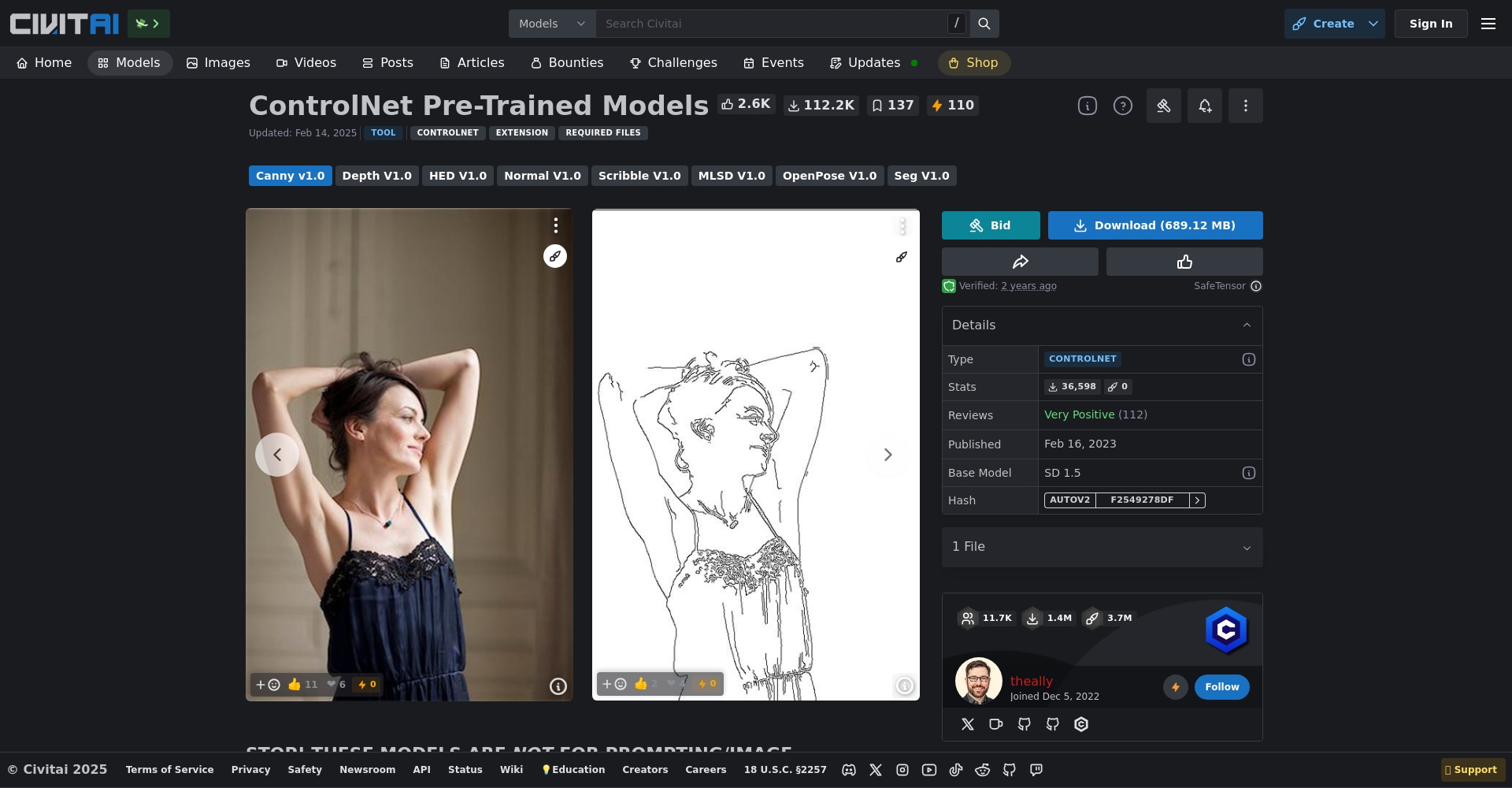

官方及社群主流控制模式清單

| 控制模型 | 簡稱/文件 | 典型場景 | 描述 |

|---|---|---|---|

| canny | control_v11p_sd15_canny | 產品/建築線稿 | 邊緣偵測,高還原形態 |

| inpaint | control_v11p_sd15_inpaint | 局部修補重繪 | 區域修改,保主體不變 |

| lineart | control_v11p_sd15_lineart | 角色/工業繪稿 | 線稿細節穩定輸出 |

| mlsd | control_v11p_sd15_mlsd | 室內外結構圖 | 直線建模,工業與建築繪畫 |

| openpose | control_v11p_sd15_openpose | 動作分鏡/動態 | 骨架還原人物動作 |

| scribble | control_v11p_sd15_scribble | 塗鴉轉正式畫 | 亂塗線稿高效生成成品 |

| normalbae | control_v11p_sd15_normalbae | 3D渲染 | 專業級法線、光線管理 |

| seg(segmentation) | control_v11p_sd15_seg | 分割換色/疊加 | 色塊精準區域控制 |

| softedge | control_v11p_sd15_softedge | 風景/肖像 | 柔和邊緣,細膩表現 |

| tile | control_v11f1e_sd15_tile | 大圖修復 | 切塊優化細節層次 |

| depth | control_v11f1p_sd15_depth | 空間/摳圖 | 深度控制空間感/換景 |

| anime lineart | control_v11p_sd15s2_lineart_anime | 二次元上色 | 專為動漫優化,多風格適配 |

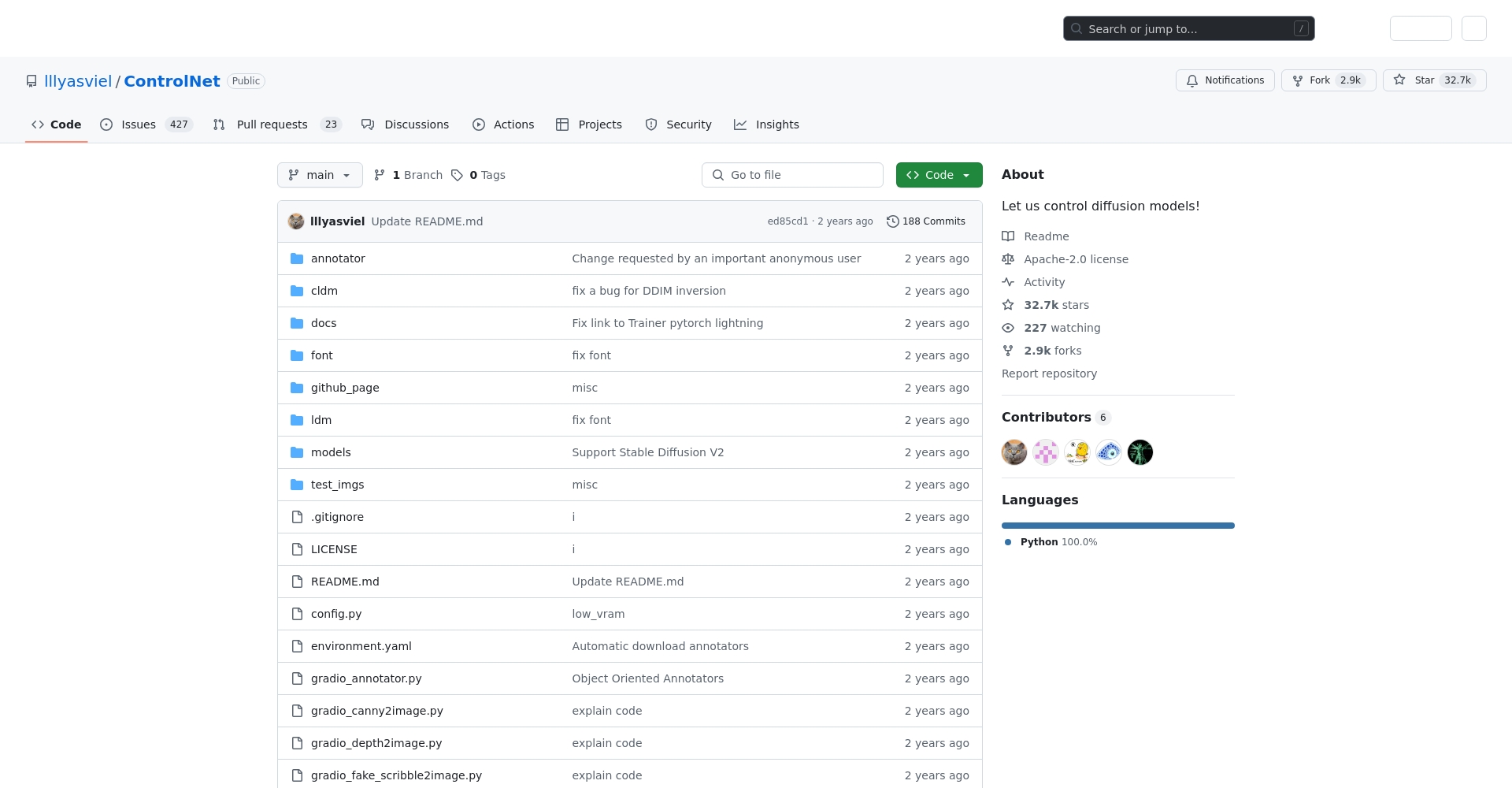

SDXL 及第三方控制net種類日益豐富,高階生態活躍,參考Huggingface, CivitAI 等模型庫。

controlnet 在主流生態中的高度集成

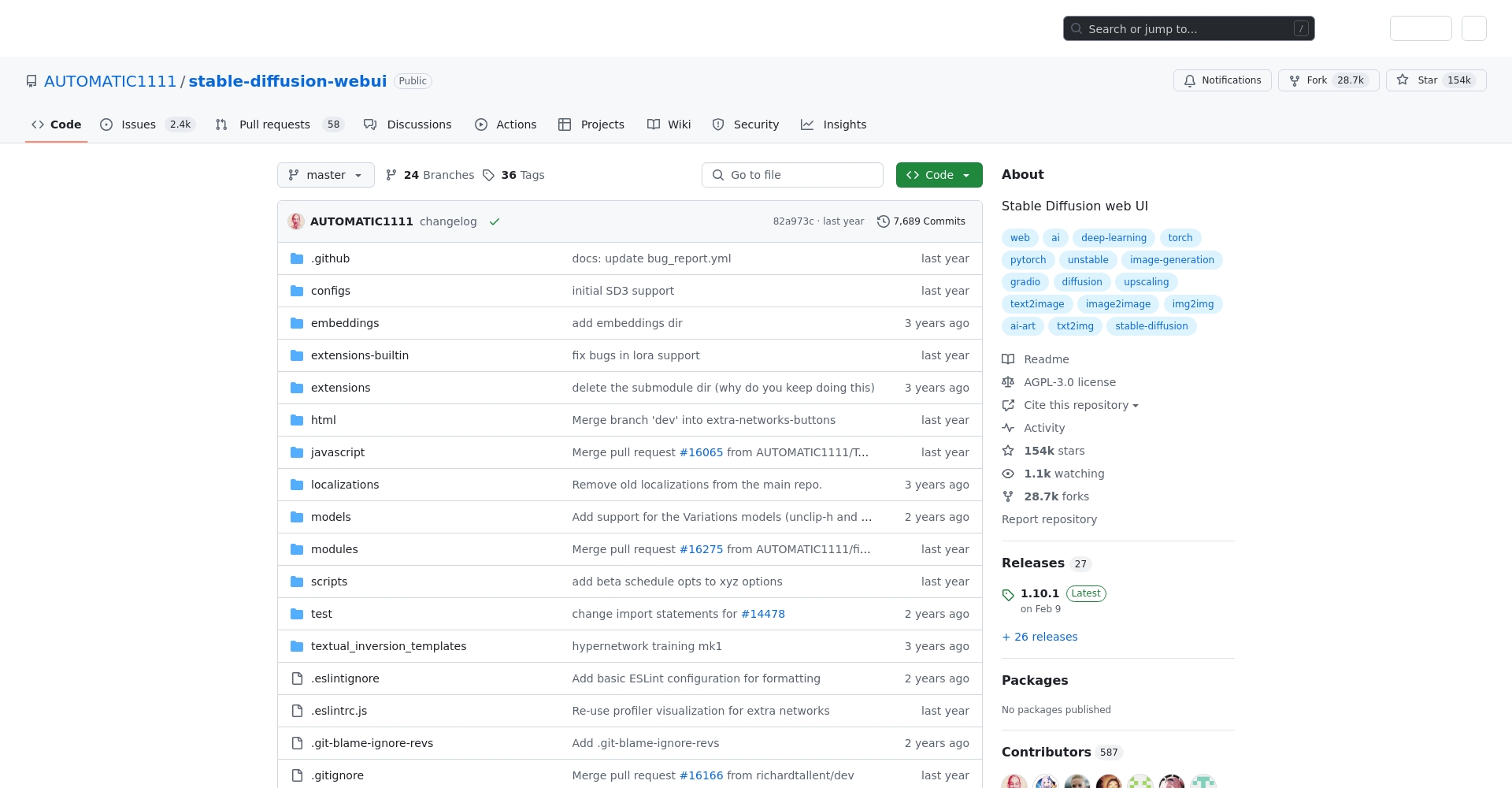

- 相容於Stable Diffusion WebUI、ComfyUI、秋葉整合包等,無需程式碼即可精細作畫。

- 多數生態內建多控制模型插件,新手10分鐘可上手,專業需求全場景覆蓋。

- SD1.5/SD2.0官方維護,SDXL社群深度發展,組合玩法靈活多變。

controlnet 的實戰技巧&高階用法

1. 單一controlnet 模型的實用場景

- 角色三視圖: openpose骨架圖配三視效果,自動產生風格統一的角色三視圖。

- 精準光源/質感: depth與normalbae聯動,指定光向與材質渲染。

- 區域換色/增物: segmentation模型分割,分區抓取或換色(如藍色區域加船)。

- 亂畫生成正式AI畫: scribble模式下隨意線稿迅速變成精緻成品。

2. 多controlnet 組合的高階技巧

| 用法類型 | 組合模型 | 操作要點 |

|---|---|---|

| 手腳精準 | openpose+depth+canny | openpose控結構,depth控空間 |

| 多角色分塊 | segmentation+openpose | 分塊定區,骨架控動作 |

| 主體背景分離 | openpose+depth或tile | 前景骨架配背景深度 |

| 風格遷移分塊上色 | canny+T2I-Adapter | canny定細節,Adapter定風格 |

| 局部重繪複合 | seg+inpaint | 分割後局部重改快速切換 |

3. Controlnet 插件與工具大全

| 工具/插件 | 用途說明 | 獲取方式 |

|---|---|---|

| Stable Diffusion WebUI | 主流可視化AI繪圖平台,內建controlnet | 項目地址 |

| ComfyUI | 節點式AI繪圖,參數自訂極強 | 專案首頁 |

| 秋葉AI繪畫套件 | 零門檻AI繪畫傻瓜包 | 秋葉AI |

| Controlnet Extensions | 各類子插件如reference、edit、lora連動等 | 官方插件庫 |

| Canny/Segment/Refer. | 影像預處理與多模態支持 | 主流WebUI內建 |

使用controlnet 的常見問題與實用建議

Q1: controlnet 支援哪些Stable Diffusion版本?

- 主推SD1.5/SD2.0,社區已支援SDXL 1.0/1.5及後續SD3。

Q2: controlnet如何提升出圖準確率?

- 需文字prompt、LoRA精調、controlnet條件圖三步驟連動,多次微調權重,精準還原。

Q3: controlnet多通道啟動時注意什麼?

- 多模型協同易互相干擾,建議先單模型調優,組合只做細微補差,配合局部重繪。

Q4: controlnet對硬體有要求嗎?

- 至少推薦16GB顯存(RTX3060以上),部分雲端平台或網頁也可低門檻體驗。

controlnet應用程式場景一覽

| 行業/場景 | 主要應用 | controlnet支援模型 |

|---|---|---|

| 電商設計 | 產品換色、智慧摳圖、批量出圖 | canny, seg, depth |

| 廣告/平面 | 角色組合、novel pose | openpose, scribble |

| 動漫/遊戲美術 | 三視圖生成、大批量動作風格化 | openpose, anime lineart |

| 建築/室內方案 | 結構圖復刻、風格轉換 | mlsd, tile, canny+T2I |

| 醫學影像 | 分割高亮、區域輔助診斷 | seg, depth |

| 教育/科普 | 彩圖示範、互動演示 | seg, normal, inpaint |

| 智慧後期 | 一鍵換景、精修年代感 | depth, inpaint, reference |

2024年以來,controlnet及其生態正席捲AI繪畫產業,從專業設計、插畫到普通愛好者,controlnet讓AI出圖像玩素描板一樣隨心所欲。用好controlnet,你的創新效率和作品品質將邁上新台階。展望未來,AI圖像創作工具必將賦予人類更多創造力。

© 版權聲明

文章版權歸作者所有,未經允許請勿轉載。

相關文章

暫無評論...