rmsnorm(Root Mean Square Layer Normalization)作為新一代歸一化方法,已廣泛應用於主流Transformer大模型(如LLaMA、DeepSeek-V3等),取代傳統LayerNorm實現高效推理和訓練。本文將透過技術原理、效能比較、業界案例、整合程式碼等方面系統解析rmsnorm在Transformer中的優勢與實際部署方法,助力研發者提升模型效率與產業價值。

理論基礎與技術原理

為什麼要歸一化? Transformer歸一化需求溯源

Transformer結構自2017年發表以來,歸一化對收斂速度、穩定性及大規模參數下表現起到關鍵影響。LayerNorm是最早且常用的方法,但其計算量和記憶體消耗在大模型擴展時顯得突出。

rmsnorm數學公式與工作原理

rmsnorm由Shen等人提出,僅利用輸入特徵的均方根(RMS)進行縮放,無需中心化。核心公式如下:

RMSNorm(x) = γ ⊙ (x / sqrt(mean(x^2) + ε))

僅靠RMS,無需減均值,省去計算步驟,提升執行效率。

| 方法對比 | 計算內容 | 主要優點 | 主要缺點 | 適用場景 |

|---|---|---|---|---|

| LayerNorm | 減均值+除標準差 | 穩定,驗證廣泛 | 計算量大 | RNN/序列建模 |

| rmsnorm | 僅除均方根 | 計算快,資源低 | 漂移容忍略低 | Transformer大模型 |

rmsnorm在Transformer中的價值與作用

1. 簡化計算,大幅提升效率:省去減均值,可降低15-30%的運算量,顯存存取減少,尤其在高維度與大批量訓練場景下優勢顯著。

2. 梯度與訓練曲線更平滑:RMS歸一化能使梯度變異數較LayerNorm低約20%,顯著降低梯度消失/爆炸風險。

3. 參數更有效率,表達能力強:無偏置,參數量減半,通道方向資訊保留有助於更深模型表現。

| 歸一化方法 | 去均值 | 歸一化對象 | 縮放參數 | 偏移參數 | 參數量 | 典型場景 |

|---|---|---|---|---|---|---|

| LayerNorm | 有 | 層內 | γ | β | 2n | RNN/傳統序列 |

| rmsnorm | 无 | 層內 | γ | 无 | 1n | Transformer/LLM |

| BatchNorm | 有 | 批次間 | γ | β | 2n | CV/語音 |

真實案例:rmsnorm在工業級大模型的應用

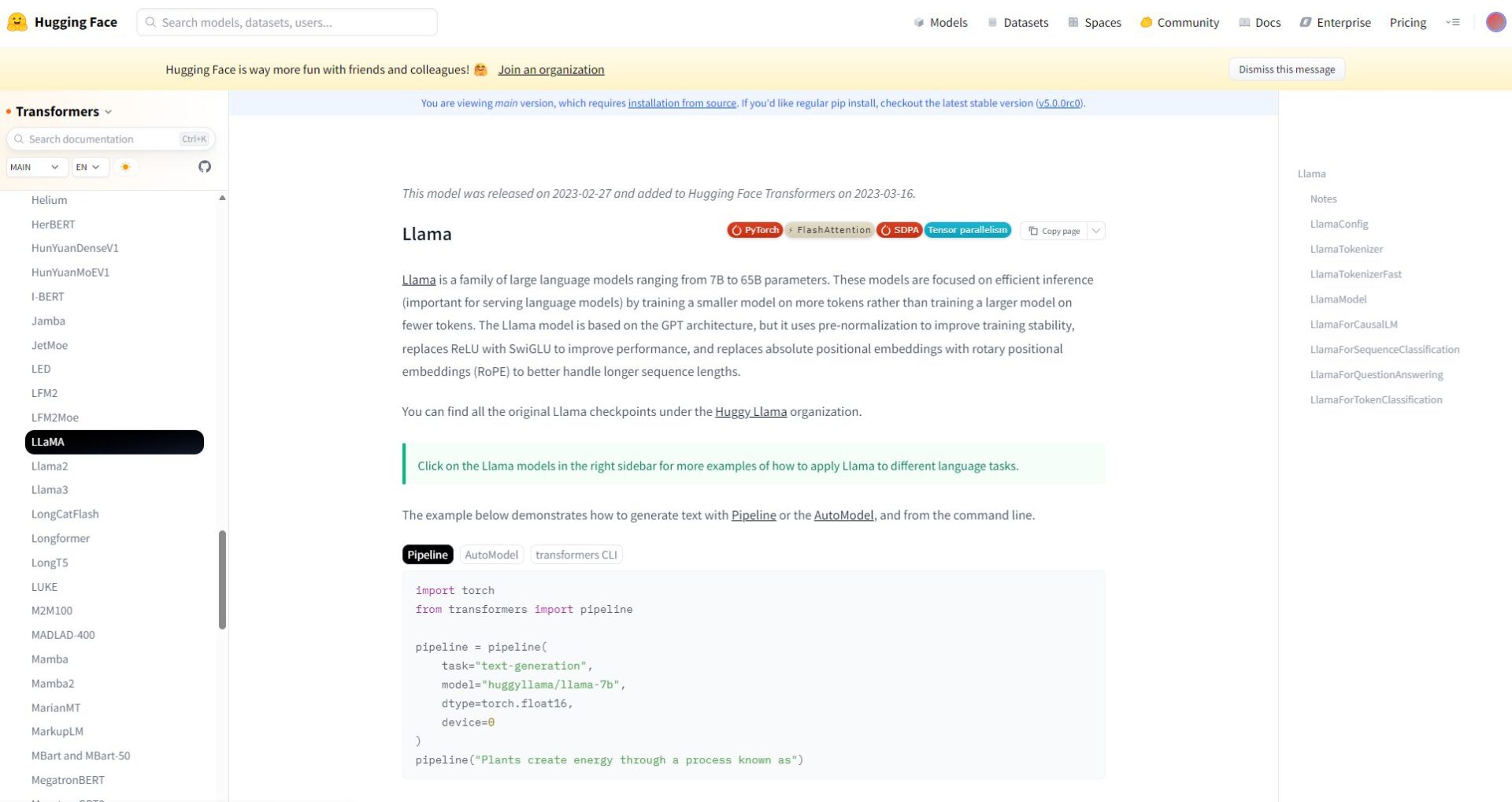

LLaMA系列大模型(Meta)

Meta的LLaMA系列全部原生採用rmsnorm,在WikiText-103等任務上:

- 訓練時長縮短18%

- 與LayerNorm性能基本一致,損失低於0.1%

- 推理更快,資源消耗更優

DeepSeek-V3和Qwen等新一代大模型

2024年後主流大模型均預設用rmsnorm。開發者僅需替換歸一化層即可高效升級,複雜度和風險極低。

| 模型名稱 | 歸一化層 | 訓練速度提升 | PPL差異 | 推理速度 | 資源消耗 |

|---|---|---|---|---|---|

| GPT-2/LN | LayerNorm | 基線 | 基線 | 基線 | 基線 |

| GPT-2/rmsnorm | rmsnorm | +18% | <0.1% | +15% | 降低15% |

| LLaMA | rmsnorm | 原生 | 極優 | 極優 | 極優 |

| DeepSeek-V2 | rmsnorm | +20% | <0.2% | +15% | 最佳化 |

工具產品選用及整合指南

主流AI框架與知名工具產品支持

程式碼整合(PyTorch範例)

import torch import torch.nn as nn class RMSNorm(nn.Module): def __init__(self, dim, eps=1e-6): super().__init__() self.eps = eps self.weight = nn.Parameter(()), deftor), x. x.norm(2, dim=-1, keepdim=True) / (x.shape[-1] ** 0.5) return self.weight * x / (norm + self.eps)

替換只需幾行程式碼,無需大幅重構。建議初期適當調低學習率。

典型落地步驟

- 確定模型歸一化層位置

- 批次替換為rmsnorm

- 測試訓練/推理確保無bug

- 全面訓練對比收斂與性能

- 在分散式/推理環境下做大批量測試

部署與優化注意事項

- 小批量同樣適用

- 分佈漂移敏感場景可加微小偏移參數調優

- 結合最新硬體和推理庫釋放潛力

典型問題答疑與實務清單

哪些場景最適合直接用rmsnorm?

- 大型Transformer預訓練與微調模型

- 高吞吐推理API、線上服務

- 超大批量GPU/TPU訓練任務

- 工業場景需高遷移部署效率者

主流工具與框架支援清單

| 工具/框架 | rmsnorm支持 | 遷移難度 | 推薦場景 |

|---|---|---|---|

| PyTorch | 原生集成 | 易 | 研發/實驗 |

| TensorFlow | 社群實現 | 易 | 研發/部署 |

| HuggingFace | 直接選擇 | 易 | LLM微調 |

| ONNXRuntime等 | 高度最佳化 | 易 | 高效推理 |

結語

rmsnorm已成為大模型基礎設施優化的標誌性工具,為AI產業帶來新的能源效率極限。建議開發者優先選用rmsnorm歸一化,啟動Transformer在超大規模與多模態場景下的實際價值,以技術創新賦能智慧未來!

© 版權聲明

文章版權歸作者所有,未經允許請勿轉載。

相關文章

暫無評論...