RunPod是一款专为AI训练和推理量身打造的高弹性云GPU平台。 它支持按需租用全球高性能NVIDIA显卡,满足从AI创业团队、研究学者到企业合规需求的多层次算力场景。主打透明弹性价格、顶级数据合规与丰富工具生态,支持主流AI模型一键部署与API自动化。产品优势包括全球多地区部署、高性能Serverless弹性推理,以及面向团队和敏感行业的企业级安全认证。RunPod已成为AI开发团队构建和上线复杂AI项目的可靠云基石。

在AI模型的训练和部署愈发成为企业和开发者日常需求的今天,大量团队都在追求一个既高效又性价比突出的云GPU平台。RunPod,正是在这种需求推动下迅速崛起的业界代表。本文将以新闻报道形式,全方位剖析RunPod(官方网站),助您判断其是否适合您的AI应用和研发部署。

RunPod平台简介

RunPod是一家专注于AI研发与推理的弹性云GPU平台,自2022年成立以来,已经服务了全球超过50万名开发者,客户遍及创新型初创企业、大型科技公司、研究机构等(详见RunPod官网)。依托高性能、弹性可扩展和极富竞争力的价格体系,RunPod让一线开发者能够低门槛获得顶级算力并快速上线自己的机器学习和深度学习项目。值得一提的是,RunPod已获得Intel Capital和Dell Technologies Capital投资,并通过了HIPAA与GDPR的合规要求,特别适合敏感数据与医疗、欧盟地区企业使用。

RunPod的主要功能

RunPod围绕AI训练和部署场景,构建了多元化产品体系。主要功能包括:

| 功能类别 | 具体描述 | 典型应用 |

|---|---|---|

| Cloud GPUs | 按需弹性租用GPU,支持近30种主流GPU机型,全球31大数据中心 | AI训练、虚拟桌面、推理API |

| Serverless | 零配置弹性AI,无需管理基础设施,秒级扩缩容,自研FlashBoot技术(冷启动<200ms) | AI推理API、低时延应用、弹性临时算力 |

| Clusters | 多节点GPU集群,支持大规模训练、分布式作业与高可用 | LLM训练、科学计算、视频/图片渲染 |

| RunPod Hub | 一站式部署主流开源AI模型,支持行业热门预设如Stable Diffusion, LLaMA等 | 快速原型、低代码上线 |

| 持久存储 | S3兼容网络硬盘,便于跨容器、跨任务数据流转 | 数据预处理、存储模型权重及结果 |

RunPod云GPU产品页

Serverless弹性推理

RunPod Hub模型部署

除此之外,RunPod支持API接口调用和自定义Docker容器部署,为开发者提供极大灵活性。平台目前还内置了实时日志、自动故障切换、权限管理等企业级特性。

典型功能亮点

- 全球多地区高性能GPU可选:A100、H100、B200、4090等顶级NVIDIA显卡,按需秒级部署。

- AI工作负载专属优化:FlashBoot冷启动、永续在线Worker、实时弹性调度,确保大规模推理/训练高可靠性。

- 合规与安全:平台SOC 2 Type II审核,满足HIPAA和GDPR,特别适合医疗、金融和欧盟数据场景。

- 可视化管理:便捷Web控制台,命令行/RESTful API双支持,适合不同研发团队技术栈。

- 场景预设丰富:涵盖文本、图片、音频、视频生成与处理,适配多行业模型生态。

RunPod归属于“AI效率提升”分类。

| 产品名称 | 功能简介 | 适用场景 |

|---|---|---|

| Pod | 按小时计费,定制GPU | 大型模型训练、批量任务 |

| Serverless | 秒级扩缩容 | 在线AI应用、消费类服务、低延时调用 |

| Instant Clusters | 多节点GPU集群 | LLM分布式训练、科学计算 |

RunPod的价格 & 方案

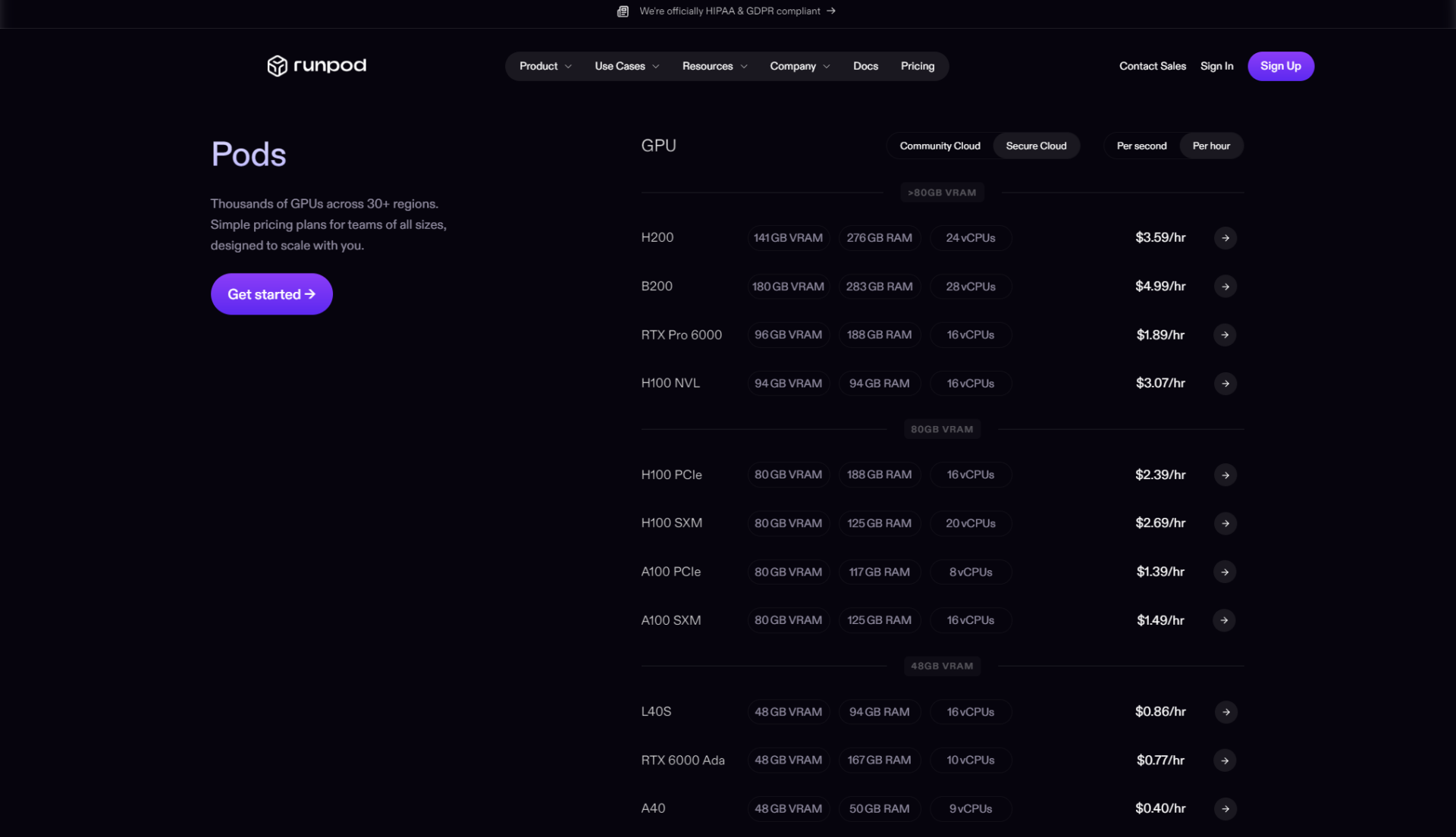

RunPod的价格政策以透明、弹性为最大卖点,支持按需计费、预留资源优惠以及社区海量算力低价专享。每种GPU按小时计价,实时价格可在官方价格页面查询。

| GPU型号 | 社区价($/hr) | 专用/企业价($/hr) | 推荐负载 |

|---|---|---|---|

| RTX 4090 | 0.34 | 0.45 | AI推理/渲染 |

| A40 | 1.2 | 1.5 | LLM推理、图片生成 |

| A100 | 3.0 | 4.5 | LLM大模型训练 |

| H100 | 5.7 | N/A | 超大模型推理/训练 |

计费模式特色

- 小时计费:只为用到的时间付费,支持自动空闲关机,避免资源闲置浪费。

- 社区实例(Spot型):一键获取折扣GPU,适用于非生产型/可中断任务,最高可省90%。

- 企业专属/安全实例:数据合规,支持与HIPAA和GDPR需求绑定的数据中心资源。

- Serverless:按秒/按调用微计费,无需长时间占用GPU即享高性能扩容。

实际价格因机型、可用性及区域微调,请以RunPod价格页为准。

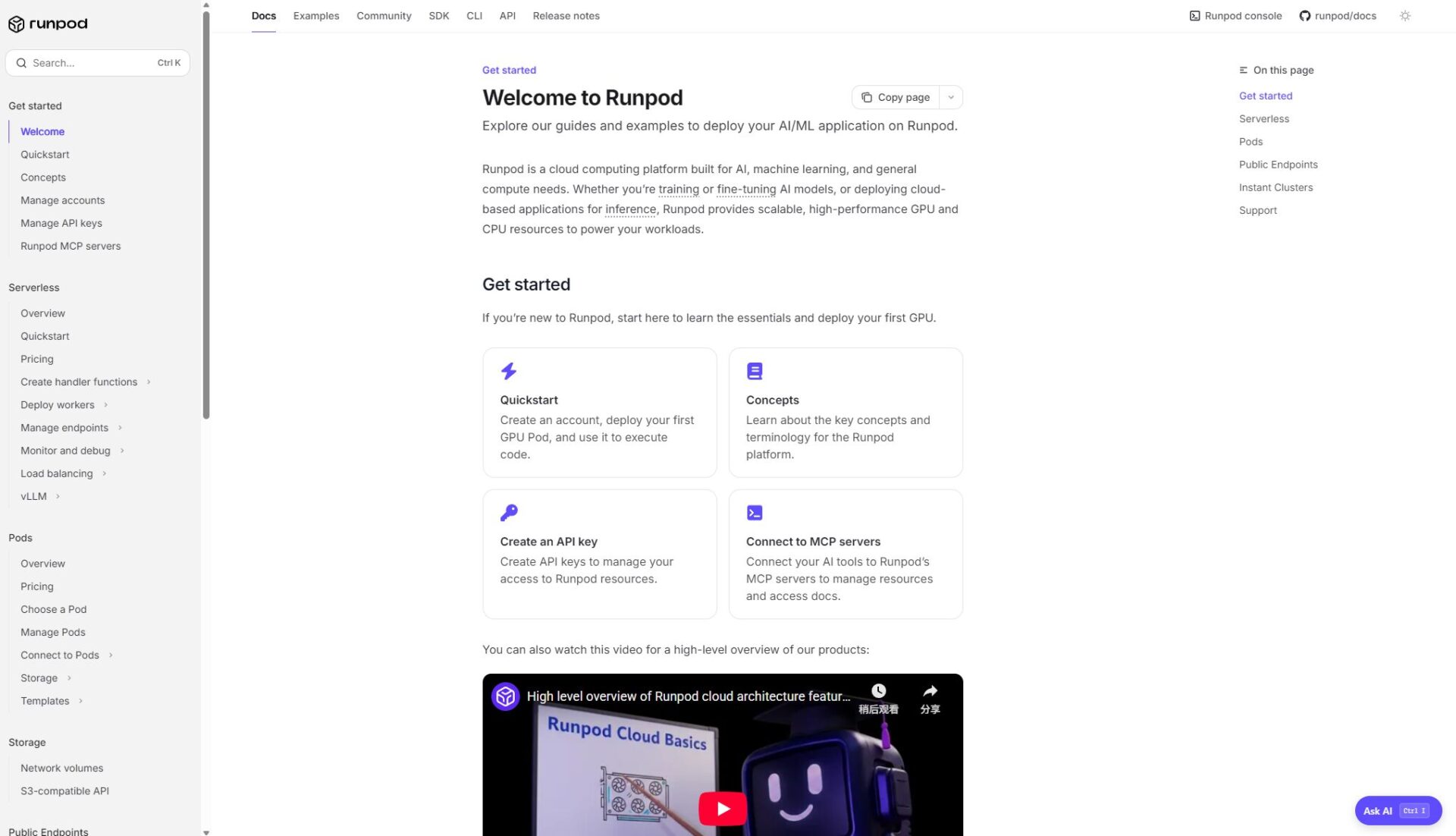

如何使用RunPod

RunPod注重“上手快、弹性强”,支持Web端、命令行、API等多方式访问。

快速上手流程

- 注册并登录RunPod:

访问注册页面 - 选择GPU资源:

进入“Pods”选择,挑选GPU类型与Region。 - 选择模板或自定义容器:

– 从数十种AI模板(如Stable Diffusion、Whisper、YOLO)选择

– 上传自己的Docker镜像,或自定义启动命令 - 配置存储及时长:

设定数据盘、镜像大小,以及自动关机策略 - 启动并管理任务:

通过Web UI实时监控,或API调用自动化运维

典型开发工作流(清单)

- 快速启动Jupyter Notebook进行实验性AI开发

- 利用专用Docker容器部署API服务

- 拉取主流AI模型模板进行推理测试

- 大型团队通过Instant Cluster进行多卡分布式训练

- 结合Serverless快速实现大流量推理API弹性部署

详细技术文档请参见RunPod官方文档。

RunPod的适用人群

RunPod面向多层次市场,其产品特性针对不同用户群体做了适配。具体如下:

| 用户类型 | 适配优势 |

|---|---|

| AI创业团队 | 上手门槛低,灵活弹性,按需计费,无需自建GPU服务器 |

| 研究机构/学者 | 社区型GPU高性价比,支持大规模分布式任务,易于分享和再现结果 |

| 企业/医疗/欧盟市场 | 支持合规要求,数据可控专属实例,适合保护隐私与法务敏感行业 |

| 普通开发者/学生 | 预装常用AI模板,一键Notebook环境,按小时轻量计费,上手极快 |

| 运维/系统工程师 | 持久化存储、API自动化、cluster部署,具备成熟DevOps能力 |

典型用例举例(真实案例详见客户案例):

- Civitai:每月训练百万模型,平台高弹性降本90%

- InstaHeadshots:AI人像生成,依赖Serverless弹性推理

- ScatterLab:秒级扩缩容满足千万级别API高并发

高级特性与开发者支持

性能与安全

- 99.9%平台可用性

- SOC 2 Type II数据安全认证

- 端到端加密、数据分区、多因素认证

- 支持GPU Benchmark实时对比

社区支持与合作

- 模型商店&Hub生态:与HuggingFace、Civitai等主流社区共建

- API/SDK丰富:官方提供详细Python、RESTful文档,适配自动化与CI/CD

- 企业多账户与资源配额管理:适合团队协作

常见问题

RunPod如何确保数据安全及合规?

RunPod平台全面通过SOC 2 Type II、HIPAA和GDPR合规审计,支持用户在部署时指定数据中心,确保数据物理隔离与法律遵从。医疗、金融及对隐私敏感的企业可签署BAA(业务伙伴协议),保障敏感信息加密存储、访问审计全流程合规。合规说明点此参考

RunPod支持哪些常见AI框架和模型模板?

平台内置Stable Diffusion、Whisper、YOLOv5、DreamBooth、LLaMA系列等主流开源模型,并支持用户上传和维护自己的Docker镜像,无论PyTorch、TensorFlow还是ONNX框架均可稳定支持。模板全目录参见

社区实例和企业实例如何选择?

- 社区实例(Spot):价格低,适合临时训练、开发测试,但会有中断风险

- 企业/专属实例:更高可用性与合规要求,适合在线推理、持续训练、敏感业务场景

详细可阅读价格与实例类型说明。

结束语

随着AI模型算力与敏感数据合规要求的同步提升,RunPod以极具弹性、透明定价和专业安全的云GPU服务,成为AI从业团队与企业推崇的首选平台之一。不论您是初创企业、学术团队,还是全球头部科技企业,RunPod都能用极具创新力的方式助力您“构建下一个AI新纪元”。

立即前往RunPod官网开启您的云GPU AI之旅!

数据统计

数据评估

本站AI 喵导航提供的RunPod都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由AI 喵导航实际控制,在2026年3月7日 下午5:19收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,AI 喵导航不承担任何责任。

相关导航

Beagle Security

通义

Resume AI

Shownotes

LowTech AI

Lamini

Plus AI